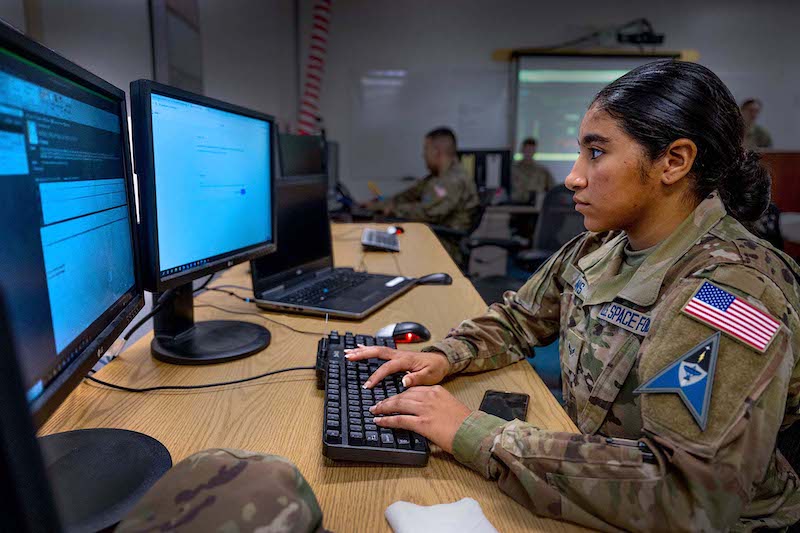

2023年9月29日,美国太空部队首席技术与创新官Lisa Costa发布了备忘录,要求除非获得官方批准,否则禁止监护人在生成性人工智能和大型语言模型解决方案中使用政府数据。

美国空军前首席软件官Nicolas Chaillan对此表示反对,他的理由是担心禁止整个技术或平台的有效性,以及与人员在个人设备上访问这些平台有关的潜在风险。

他说,“当人们被禁止使用政府设备,而你被禁止使用你的设备(访问这些平台)时,这将迫使人们使用他们的个人设备……你所做的只是创造更多的影子IT和更多的网络风险。”

美国空军开发了基于生成式人工智能的Ask Sage平台,它运行在政府云上面,满足所有网络安全先决条件。

在过去的六个月里,大约有500名监护人使用了该平台,没有安全事件报告。他还表示,目前整个国防部有10,000名Ask Sage用户。

对于该说法,美国国防部发言人表示无法核实Ask Sage用户的确切数量,但在一份声明中,他们回应了相关担忧。

发言人通过电子邮件表示:“大模型为帮助美国国防部人员完成各种任务提供了巨大的承诺,但我们必须确保在使用此类平台时保护敏感的国防部数据。”

他强调,“人们对大模型提供的答案的可追溯性和有效性也表示了合理的担忧。”

美国太空部队发言人Tanya Downsworth少校表示,暂时禁止大模型的目的是为了开展评估,通过研究风险管理方法,并鼓励试点项目收集数据,为决策提供信息。

然而,部分军方人士认为,如此快速发展的技术的任何延迟都意味着有可能失去在大国竞争中的不利地位。

到目前为止,美国国防部官员尚未就建立自己的生成式人工智能或大模型进行公开讨论。

在8月,美国国防部宣布成立利马特别工作组,由首席数字与人工智能办公室领导。该特别工作组致力于通过生成式人工智能在各个国防领域推进国家安全。

不管怎样,美军不太可能放弃生成式人工智能在军事任务中应用的企图,这也是《军事人工智能白皮书》中所表达的观点。

评论