近期,美国空军和麻省理工学院(MIT)共同展示了X-62A战斗机,这是一架由AI驾驶的战斗机,它是由F-16D战斗机改装而成,这意味着美军可以利用大量退役的F-16战斗机进行改装,从而拥有一个庞大的无人战斗机部队。

数字孪生战场实验室一直跟踪研究美国空军和MIT合作情况,因为该项目利用了数字孪生体、人工智能和数据科学等新一代数字技术。

不仅如此,为了让AI战斗机具有实用性,MIT引入了其他看似不相关的学科,例如心理学。

跟人的复杂认知能力不同,现代AI虽然具有很强的计算速度,但如果要拥有人一样的智能,就需要增加它适应新环境不确定性的能力,这对于AI战斗机至关重要,因为它不能在试验场或自己熟悉的空域飞行。

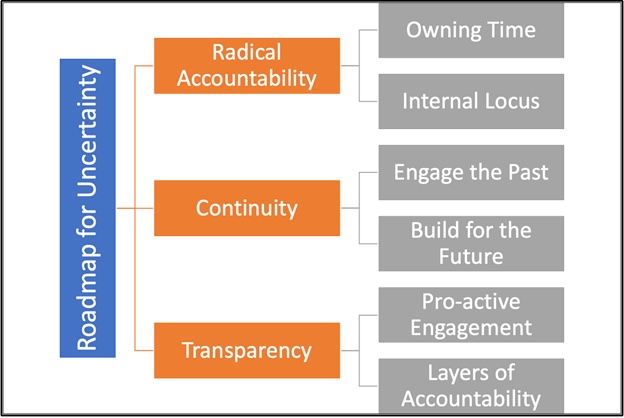

为了加速AI战斗机的发展,MIT设计了一套“不确定性发展路标”,加强发展AI战斗机适应新环境不确定性的能力。

从认知心理学来讲,为什么大多数人在新环境会感到不舒服?如果预计会遇到新环境,研究什么因素有助于在新的和不断变化的环境中变得更舒适,对发展AI战斗机具有重要意义。

不确定性发展路线图有三条指导原则:激进问责制、连续性和透明度。

激进问责制要求个人必须对整个工作流程承担个人责任,包括考虑相关问题,例如,谁将完成所需的工作;如何完成工作;以及何时以及如何跟踪进度。

对于连续性问题基于个人的新环境并不意味着环境是新的的考虑。研究、参考和重新利用历史先例中的相关文物。连续性是有原因的。

寻找最近的知识管理档案/程序-知识管理通常是一个未被充分利用但关键的资源,把这些信息和数据分不到数字孪生环境中,能够巩固参与过去和建设未来的反馈。

MIT认为,与其专注于现在如何做到这一点,不如考虑现在所做的事情如何影响未来的实施和生存能力。

最后,对于新环境,很难确定是否满足要求,或者如何满足期望。

首先,确定需要完成哪些工作以及需要向谁报告的基线。主动让正在评估工作成果的人参与进来,并制定如何实现任何既定目标的计划。

当在不确定的环境中操作时,知道一个人是如何被评估的不应该是未知的。为评估奠定基础,并制定如何满足要求的计划。问责层,包括概念化个人和团队/团体动态如何与建立评估和实现目标的基础相交,提供了可衡量的价值和明确的努力路线。追踪工作是如何被摄入和优先考虑的,问责过程和沟通流程是管理绩效和期望似乎很困难的任务的关键结构。

利用这套“不确定性发展路线图”,MIT帮助美国空军不断发展AI战斗机,让该飞机更有效的跟不断发展中的JADC2协作起来,从而让这套机制成为未来战争的基础。

评论